Y para acabar el día, tras las presentaciones sobre Web Quality, y las de credibilidad y confianza, ahora le llega el turno a la detección y prevención de abusos (y spam).

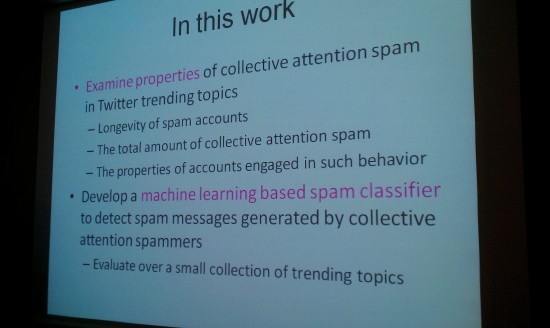

La primera charla es Detecting Collective Attention Spam (de Kyumin Lee, James Caverlee, Krishna Kamath y Zhiyuan Cheng).

Aparecer en la página principal de Youtube, eventos como el Año Nuevo generan marketing viral y atención colectiva, consiguiendo ser «trend» (Google Trends o Twitter Trending Topic). En general los spammers van a por momentos de atención que se convierten en fenómenos.

Primero se consigue información de los temas con tendencia y se generan contenidos para twitter, afcebook, youtube, foursquare… eso genera atención por parte de los usuarios.

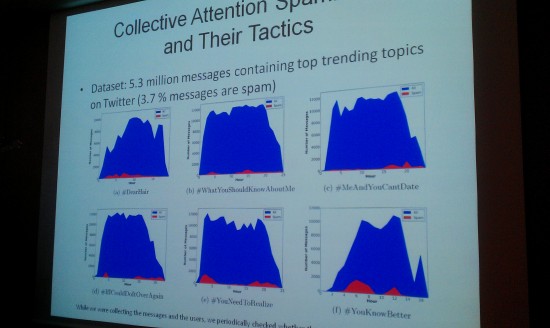

En general los spammers en Twitter, a diferencia de lo que se podría suponer en Social media, suelen tener 0 seguidores y siguen a 0 personas, con una media de 9 mensajes. En general, las cuentas de spam suelen tener un pico de mensajes, otro pico al cabo de un mes, y otro pico dos meses después (a los 3 meses). Es interesante un 75% de las cuentas spam son suspendidas por parte de twitter en menos de 24 horas (principalmente en las 6 primeras horas).

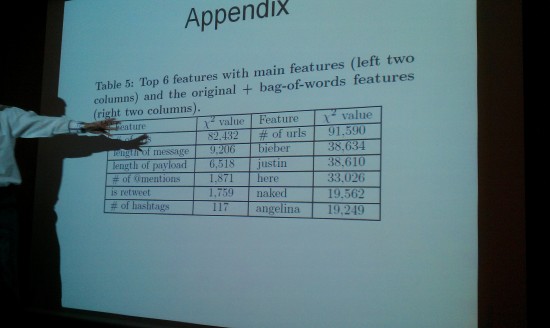

Los scammers suelen usar nombres de famosos para generar spam. Además, se suelen usar redirectores tipo BitLy, a los que añaden parámetros y que son utilizados a lo largo del tiempo cada vez más.

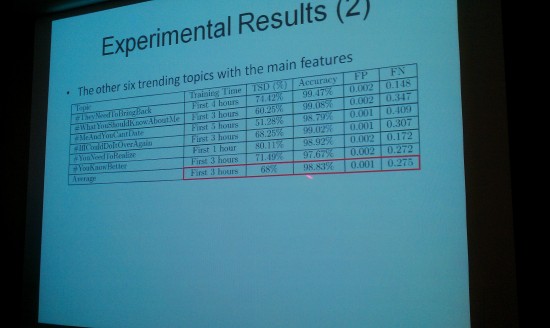

Un 75% de los mensajes de spam pueden detectarse en las primeras 2 horas según se lanzan los primeros ataques. Los falsos positivos rondan el 2 por mil.

Lo que se analiza es todos los conceptos que entran como Trending Topic como sistema de muestreo. En resumen se puede detectar los mensajes de spam al poco tiempo con una alta detección (cerca del 99% en 3 horas).

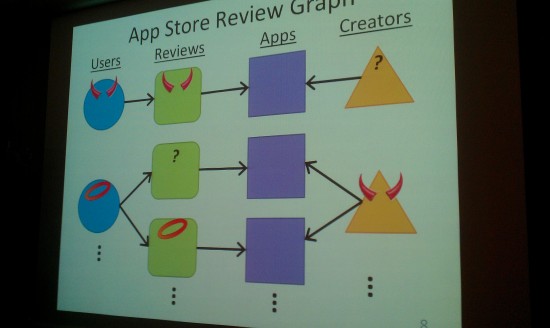

Las siguientes charla es Identifying Spam in the iOS App Store (de Rishi Chandy y Haijie Gu) en la que se analiza cómo detectar spam en las aplicaciones de la Apple Store.

Entre 2008 y 2012 se han añadido más de medio millón de aplicaciones a la App Store. Las grandes aplicaciones tienen un problema, ye s que no se sabe bien cómo gestionan los datos privados. Por ejemplo el caso Path.

Algunos spammers (desarrollaodres) pagan a usuarios para que hagan reseñas positivas en la App Store.

Por ahora lo que se analiza es el valor de las reseñas, la cantidad de las reseñas, cuántas reseñas tienen cada usuario y sus valores y cuántas reseñas tiene el desarrollador y sus valores.

La última presentación es kaPoW Plugins: Protecting Web Applications Using Reputation-based Proof-of-Work (de Akshay Dua, Wu-Chang Feng y Tien Le).

El spam funciona. En twitter, por ejemplo, funciona el doble mejor que en el caso del correo, si los comparamos. Uno de los sistemas que se usan para parar el spam son los captchas, pero cada vez tienen más problemas ya que son más sencillos de hackear. También existen los filtros antispam, pero tienen falsos positivos. Otro elemento es la opción de reporting del usuario (como por ejemplo hace Twitter) aunque puede llegar tarde.

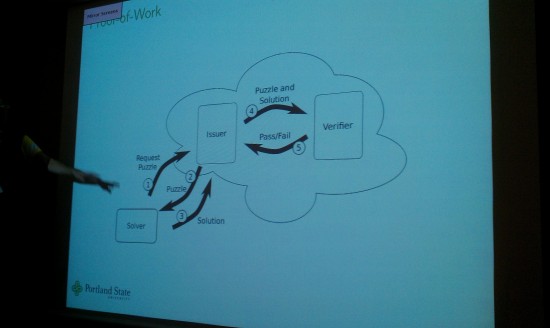

Una opción para mejorar este sistema podría ser el imponer un coste por cada mensaje. Una opción podría ser la de jugar con puzzles. Esto reduciría la velocidad del spam. Por ejemplo a los usuarios nuevos se les pueden poner puzzles más complejos y a los que llevan tiempo cada vez más sencillos para mejorar la velocidad.

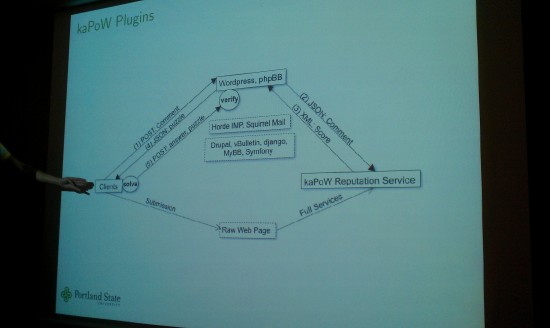

Esto se podría organizar con un sistema de plugins, por ejemplo para WordPress o phpBB. Los usuarios tendrían una puntuación que permite que la dificultad del puzzle sea mayor o menos.

En el correo sería algo más complejo de aplicar. Además, los puzzles tienen una limitación de tiempo. Lo primero que se ha de establecer es la dificultad del puzzle. La dificultad se basa en la reputación. Esto vendría de una mezcla de pesos entre puntuaciones locales y globales, por ejemplo, si la IP está en listas negras, si la cuenta es nueva o no…

Se puede ver más información sobre este sistema en kaPoW: Web-based Client Puzzles.

Deja una respuesta